نویسنده: فاطمه نوریان

تعداد بازدید: 45

ایجاد: ۱۴۰۴/۰۵/۱۲ ساعت ۱۷:۲۱:۵۳

هوش مصنوعی توضیحپذیر (Explainable AI): چرا مهمه و چطور کار میکنه؟

________________________________________

مقدمه

این روزها هوش مصنوعی (AI) همهجا هست؛ از گوشیهامون گرفته تا ماشینهای خودران، سیستمهای پزشکی، بانکها و حتی شبکههای اجتماعی. اما یه مشکلی که خیلی از سیستمهای هوش مصنوعی دارن اینه که نمیتونیم دقیق بفهمیم چرا یه تصمیم خاص گرفتن. انگار با یه «جعبه سیاه» طرفیم که فقط ورودی میگیره و خروجی میده، بدون اینکه توضیح بده بین این دو چی گذشته.

اینجاست که یه شاخه مهم به اسم هوش مصنوعی توضیحپذیر (Explainable AI یا XAI) وارد میشه. این شاخه سعی میکنه مدلهای هوش مصنوعی طوری طراحی بشن یا بعداً توضیح داده بشن که ما انسانها بفهمیم چطوری به یه نتیجه رسیدن.

________________________________________

چرا باید AI توضیح بده؟

خیلی ساده بگیم، چون بدون توضیح نمیتونیم:

• بهش اعتماد کنیم. اگه بدونیم چرا یه سیستم جواب خاصی داده، راحتتر بهش تکیه میکنیم.

• خطاها رو بفهمیم و اصلاح کنیم. وقتی مدل اشتباه میکنه، باید بدونیم از کجا اشتباه شروع شده.

• از نظر قانونی یا اخلاقی پاسخگو باشیم. مثلا تو حوزه پزشکی یا حقوق، نمیتونیم فقط بگیم «کامپیوتر اینو گفت»؛ باید بتونیم تصمیم رو توضیح بدیم.

• با خیال راحت ازش استفاده کنیم. چون قراره بعضی تصمیمها واقعاً مهم باشن (مثلاً رد یا قبول شدن یه وام یا تشخیص یه بیماری).

________________________________________

چطوری میتونیم تصمیمهای AI رو توضیح بدیم؟

راههای مختلفی برای توضیحپذیر کردن مدلها وجود داره:

۱. مدلهای ساده و شفاف

مدلهایی مثل درخت تصمیم یا رگرسیون خطی ذاتاً قابل فهم هستن. مثلاً میتونیم بگیم:

«اگه سن بالای ۴۰ باشه و درآمد بیشتر از ۱۰ میلیون، وام تایید میشه.»

اما مشکل اینجاست که این مدلها سادهان و همیشه دقت بالایی ندارن.

________________________________________

۲. توضیح بعد از آموزش مدلهای پیچیده

مدلهای قوی مثل شبکههای عصبی یا GPT خیلی خوب جواب میدن، ولی قابل درک نیستن.

برای همین از ابزارهایی مثل این استفاده میکنن:

• LIME: یه مدل ساده اطراف هر پیشبینی میسازه و توضیح میده چرا اون پیشبینی داده شده.

• SHAP: دقیقتره و به هر ویژگی (مثل سن، درآمد، تحصیلات) یه نمره میده که بگه چقدر تو تصمیم نهایی تاثیر داشته.

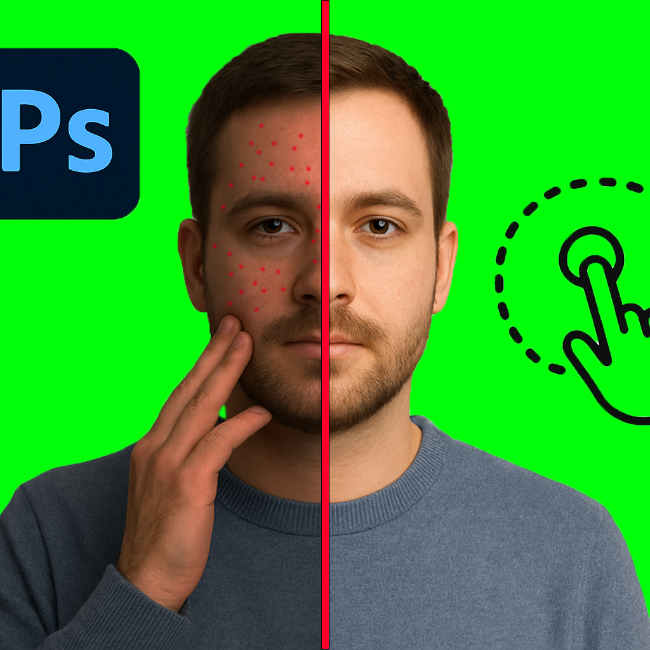

• نقشههای توجه (Attention Maps): مثلا تو مدلهای پردازش تصویر یا زبان نشون میده مدل بیشتر به کجای تصویر یا متن توجه کرده.

________________________________________

چالشها و مشکلات

هوش مصنوعی توضیحپذیر خیلی مفیده، ولی خودش هم بیچالش نیست:

• دقیق vs قابل فهم: گاهی مدلهایی که خیلی خوب کار میکنن، اصلاً قابل توضیح نیستن. و برعکس.

• توضیحات ممکنه گمراهکننده باشن: بعضی وقتا توضیحهایی که ارائه میشن واقعی نیستن، فقط به نظر درست میان.

• برای همه قابل فهم نیست: یه توضیح ممکنه برای یه مهندس قابل فهم باشه، ولی برای یه کاربر معمولی نه.

• ممکنه به مدل آسیب بزنه: بعضی اطلاعات که برای توضیح استفاده میشن، میتونن توسط هکرها سوءاستفاده بشن.

________________________________________

نتیجهگیری

هوش مصنوعی توضیحپذیر یه قدم مهم برای ساختن سیستمهای هوشمند قابل اعتماد و مسئولیتپذیره. اینکه فقط یه مدل با دقت بالا داشته باشیم کافی نیست؛ باید بفهمیم چرا این مدل این تصمیم رو گرفته.

با رشد AI در زندگی روزمرهمون، نیاز داریم مدلها نهتنها هوشمند، بلکه شفاف و قابل درک هم باشن. آیندهی AI به این بستگی داره که بتونیم اعتماد آدمها رو جلب کنیم — و توضیح دادن، اولین قدمه.

شما اولین نظر را ثبت کنید!

.webp)

.jpg)

.png)

.jpg)

.jpg)